Tomado de Universo Abierto

Gale Sinatra and Barbara K. Hofer, The. «How ChatGPT and Generative AI Could Foster Science Denial». Gizmodo, 11 de junio de 2023. https://gizmodo.com/chatgpt-generative-ai-openai-science-denial-1850516570.

Todos los consumidores de medios de comunicación deben estar más atentos que nunca a la hora de verificar la veracidad científica. He aquí cómo mantenerse alerta en un nuevo panorama informativo.

Hasta hace muy poco, si deseabas obtener más información sobre un tema científico controvertido, como la investigación con células madre, la seguridad de la energía nuclear o el cambio climático, probablemente hacías una búsqueda en Google. Presentado con múltiples fuentes, elegías qué leer, seleccionando los sitios o autoridades en los que confiar.

Ahora tienes otra opción: puedes plantear tu pregunta a ChatGPT u otra plataforma de inteligencia artificial generativa y recibir rápidamente una respuesta concisa en forma de párrafo.

ChatGPT no busca en Internet de la misma manera que lo hace Google. En cambio, genera respuestas a las consultas prediciendo combinaciones de palabras probables a partir de una amalgama masiva de información disponible en línea.

Aunque tiene el potencial de mejorar la productividad, se ha demostrado que la IA generativa tiene algunos fallos importantes. Puede producir información errónea. Puede crear “alucinaciones“, un término benigno para inventar cosas. Y no siempre resuelve con precisión problemas de razonamiento. Por ejemplo, cuando se le preguntó si un automóvil y un tanque pueden pasar por una puerta, no consideró tanto el ancho como la altura. Sin embargo, ya se está utilizando para producir artículos y contenido web que es posible que hayas encontrado, o como una herramienta en el proceso de escritura. Aun así, es poco probable que sepas si lo que estás leyendo fue creado por la IA.

Como autores de “Science Denial: Why It Happens and What to Do About It» (Negación de la Ciencia: Por qué Ocurre y Qué Hacer al Respecto), preocupa cómo la IA generativa podría difuminar los límites entre la verdad y la ficción para aquellos que buscan información científica autoritaria.

Cada consumidor de medios necesita ser más vigilante que nunca al verificar la precisión científica en lo que lee. Así es cómo puedes mantenerte alerta en este nuevo panorama de la información.

Cómo la IA generativa podría fomentar la negación de la ciencia

- Erosión de la confianza epistémica: Todos los consumidores de información científica dependen de los juicios de expertos científicos y médicos. La confianza epistémica es el proceso de confiar en el conocimiento que se obtiene de otros. Es fundamental para la comprensión y el uso de información científica. Ya sea que alguien esté buscando información sobre una preocupación de salud o tratando de comprender soluciones para el cambio climático, a menudo tienen un entendimiento científico limitado y poco acceso a evidencia de primera mano. Con un creciente cuerpo de información en línea, las personas deben tomar decisiones frecuentes sobre qué y a quién confiar. Con el aumento del uso de la IA generativa y su potencial de manipulación, creemos que la confianza es probable que se erosioné aún más de lo que ya lo ha hecho.

- Desinformación o simplemente incorrecto: Si hay errores o sesgos en los datos con los que se entrenan las plataformas de IA, eso puede reflejarse en los resultados. En nuestras propias búsquedas, cuando le hemos pedido a ChatGPT que regenere múltiples respuestas a la misma pregunta, hemos obtenido respuestas contradictorias. Cuando se le preguntó por qué, respondió: “A veces cometo errores». Quizás el problema más complicado con el contenido generado por IA es saber cuándo está equivocado.

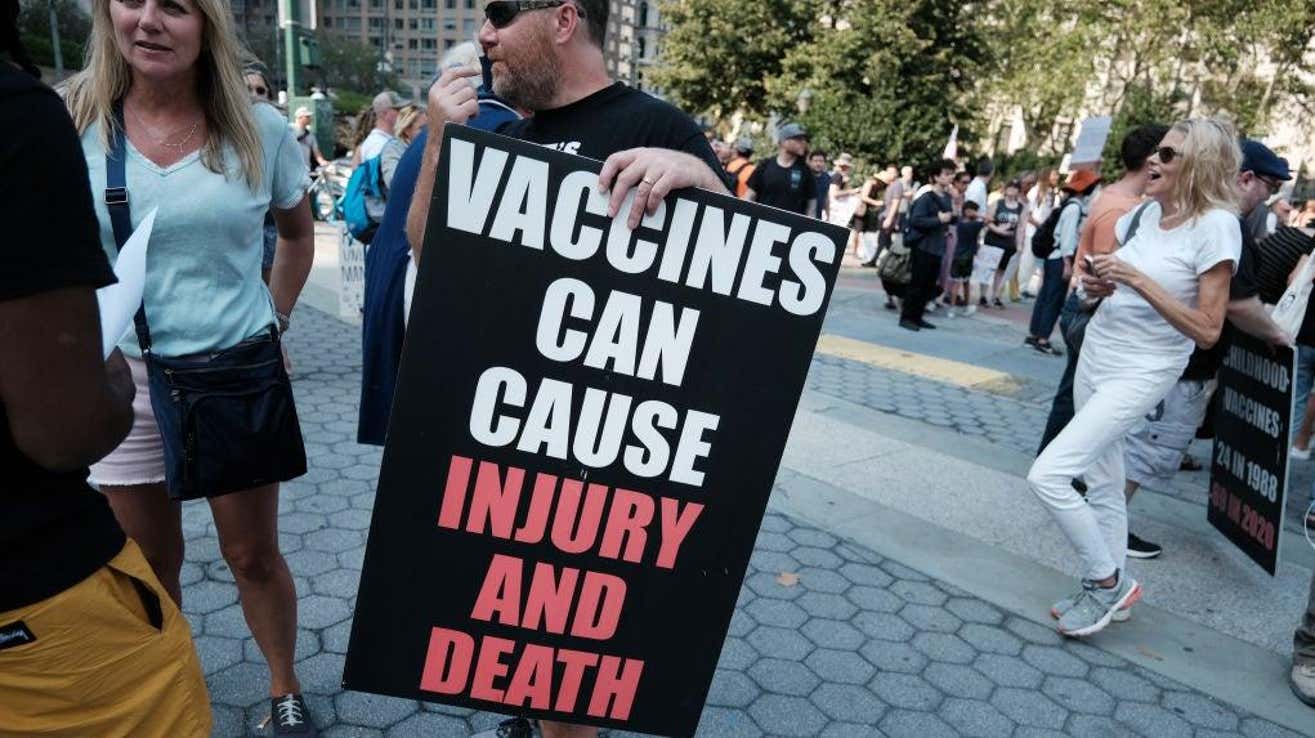

- Diseminación deliberada de desinformación: La IA se puede utilizar para generar desinformación convincente en forma de texto, así como imágenes y videos deepfake. Cuando le preguntamos a ChatGPT que “escribiera sobre las vacunas al estilo de desinformación», produjo una cita inexistente con datos falsos. Geoffrey Hinton, exjefe de desarrollo de IA en Google, renunció para poder dar la alarma, diciendo: “Es difícil ver cómo se puede evitar que los actores malintencionados lo utilicen para cosas malas». La capacidad de crear y difundir información deliberadamente incorrecta sobre la ciencia ya existía, pero ahora es peligrosamente fácil.

- Fuentes fabricadas: ChatGPT proporciona respuestas sin fuentes en absoluto, o si se le pide que proporcione fuentes, puede presentar fuentes inventadas. Ambos le pedimos a ChatGPT que generara una lista de nuestras propias publicaciones. Cada uno identificó algunas fuentes correctas. Más fueron alucinaciones, pero parecían ser reputables y en su mayoría plausibles, con coautores reales en revistas de sonido similar. Esta inventiva es un gran problema si una lista de publicaciones de un académico transmite autoridad a un lector que no se toma el tiempo para verificarlas.

- Conocimiento desactualizado: ChatGPT no sabe lo que ha sucedido en el mundo después de la fecha de corte de su conocimiento. Una consulta sobre el porcentaje de personas en el mundo que han tenido COVID-19 devolvió una respuesta precedida por “según mi fecha de corte de conocimiento de septiembre de 2021». Dado lo rápido que avanza el conocimiento en algunas áreas, esta limitación podría significar que los lectores obtengan información errónea y desactualizada. Si estás buscando investigaciones recientes sobre un problema de salud personal, por ejemplo, ten cuidado.

- Avance rápido y falta de transparencia: Los sistemas de IA siguen volviéndose más poderosos y aprenden más rápido, y pueden aprender más desinformación científica en el camino. Google anunció recientemente 25 nuevos usos incrustados de la IA en sus servicios. En este momento, no hay suficientes salvaguardias para garantizar que la IA generativa se convierta con el tiempo en un distribuidor más preciso de información científica.

¿Qué puedes hacer acerca de las alucinaciones de la IA?

Si utilizas ChatGPT u otras plataformas de IA, reconoce que es posible que no sean completamente precisas. La responsabilidad recae en el usuario para discernir la precisión.

Aumenta tu vigilancia. Es posible que pronto estén disponibles aplicaciones de verificación de hechos con IA, pero por ahora, los usuarios deben servir como sus propios verificadores de hechos. Recomendamos algunos pasos. El primero es: sé vigilante. Las personas a menudo comparten información que encuentran en búsquedas en las redes sociales con poco o ningún análisis. Aprende cuándo ser más reflexivo y cuándo vale la pena identificar y evaluar las fuentes de información. Si estás tratando de decidir cómo gestionar una enfermedad grave o entender los mejores pasos para abordar el cambio climático, tómate el tiempo para verificar las fuentes.

Mejora tu verificación de hechos. Un segundo paso es la lectura lateral, un proceso que utilizan los verificadores de hechos profesionales. Abre una nueva ventana y busca información sobre las fuentes, si se proporcionan. ¿La fuente es creíble? ¿El autor tiene experiencia relevante? ¿Cuál es el consenso de los expertos? Si no se proporcionan fuentes o no sabes si son válidas, utiliza un motor de búsqueda tradicional para encontrar y evaluar a expertos en el tema.

Evalúa las pruebas. A continuación, observa las pruebas y su conexión con la afirmación. ¿Hay evidencia de que los alimentos genéticamente modificados son seguros? ¿Hay evidencia de que no lo son? ¿Cuál es el consenso científico? Evaluar las afirmaciones requerirá esfuerzo más allá de una consulta rápida a ChatGPT.

Si comienzas con la IA, no te detengas allí. Ten precaución al usarla como la única autoridad en cualquier tema científico. Puedes consultar lo que ChatGPT tiene que decir sobre organismos genéticamente modificados o la seguridad de las vacunas, pero también realiza una búsqueda más diligente utilizando motores de búsqueda tradicionales antes de sacar conclusiones.

Evalúa la plausibilidad. Juzga si la afirmación es plausible. ¿Es probable que sea cierta? Si la IA hace una declaración poco plausible (y incorrecta), como “1 millón de muertes fueron causadas por las vacunas, no por el COVID-19», considera si tiene sentido. Haz un juicio tentativo y luego mantente abierto a revisar tu pensamiento una vez que hayas verificado la evidencia.

Promueve la alfabetización digital en ti mismo y en otros. Todos necesitan mejorar sus habilidades. Mejora tu propia alfabetización digital y, si eres padre, maestro, mentor o líder comunitario, promueve la alfabetización digital en los demás. La Asociación Estadounidense de Psicología ofrece orientación sobre cómo verificar información en línea y recomienda que los adolescentes sean capacitados en habilidades de redes sociales para minimizar los riesgos para la salud y el bienestar. El Proyecto de Alfabetización en Noticias proporciona herramientas útiles para mejorar y apoyar la alfabetización digital.

Arma-te con las habilidades que necesitas para navegar por el nuevo paisaje de información de la IA. Incluso si no utilizas la IA generativa, es probable que ya hayas leído artículos creados por ella o desarrollados a partir de ella. Puede llevar tiempo y esfuerzo encontrar y evaluar información confiable sobre ciencia en línea, pero vale la pena.

Gale Sinatra, Profesora de Educación y Psicología en la Universidad del Sur de California y Barbara K. Hofer, Profesora Emérita de Psicología en Middlebury.

Tomado de Universo Abierto

No hay comentarios:

Publicar un comentario

Ingrese su texto en esta ventana. Aparecerá publicado pasadas unas horas. Muchas gracias.